スマートフォンやブラウザから呼び出すだけでなく、自分の部屋の片隅に常時稼働するマシンを置き、そこにAIエージェントを常駐させる、そういう使い方が、静かに広がりつつあります。

スケジュールのチェック、メールの下書き、ニュースの要約、コードのレビュー、ファイルの整理。

自分が寝ている間も、会議に出ている間も、AIが裏で粛々とタスクをこなしてくれます。

その”家”として、2020年に登場した Mac Mini M1 以降の Apple Silicon 搭載モデルは、最良の選択肢の一つです。

M1から・M2・M4まで、世代を問わず共通して成立する理由があります。それを電力・性能・静音性の三つの軸から解説していきます。

Apple Silicon の世代と、AI用途における立ち位置

まず、Mac Mini の Apple Silicon 系譜を整理しておきましょう。

| モデル | 発売 | チップ | 最大メモリ | Neural Engine |

|---|---|---|---|---|

| Mac Mini M1 | 2020年11月 | M1 / なし | 16GB | 16コア |

| Mac Mini M2 / M2 Pro | 2023年1月 | M2 / M2 Pro | 32GB(Pro) | 16コア |

| Mac Mini M4 / M4 Pro | 2024年11月 | M4 / M4 Pro | 64GB(Pro) | 16コア |

チップの世代が上がるにつれ、メモリ帯域幅・GPU コア数・Neural Engine の処理速度はいずれも向上しています。しかしAI の常駐ホストとしての基本的な優位性は、M1 から M4 まで一貫して共有されています。その根拠が、UMA という設計思想です。

UMA がなぜ AI に向いているのか

Apple Silicon 全世代に共通する最大の特徴は、UMA(Unified Memory Architecture:統合メモリアーキテクチャ)です。

このUMA、新しい技術ではないのですが、一般的なコンピュータでは、CPU 用の RAM と GPU 用の VRAM は物理的に分離されているのが普通です。AI の推論処理(モデルを動かすこと)には大量のメモリ帯域が必要なため、データを CPU 側から GPU 側へ「転送」するコストが常についてまわります。

UMA はこの壁を取り払います。CPU も GPU も、そして Apple 独自の Neural Engine も、同一の高帯域メモリプールを共有します。データの転送オーバーヘッドがなく、モデルのパラメータをメモリに展開したまま、CPU・GPU・Neural Engine が協調して推論を走らせることができます。

この設計は M1 から M4 まで変わりません。M1 の 16GB でも、Mistral 7B や Llama 3 8B クラスのモデルをローカルで動かすには十分なメモリ帯域を持っています。M2 以降では帯域がさらに広がり、M4 Pro(64GB)に至ってはローカル 30B クラスのモデルも現実的な速度で扱えます。

なぜ 8GB でも「かなりのこと」ができるのか

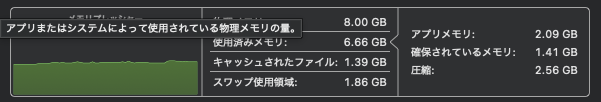

「Mac は 8GB しかないのに、なぜ Windows の 16GB より快適なのか?」

Apple SiliconのMacを使っている方が最初に抱く疑問です。

実際、今私はこの記事をM1 Mac Mini 8GBで書いています。Google Chromeで30以上のタブを開き、Claude Codeで負荷のかかる作業をおこなっても実際、ストレスを感じません。

これには、互いに関連した三つの理由があります。

理由1:VRAM を「奪われない」

Windows PC で 16GB の RAM を搭載していても、GPU(グラフィックカード)が専用 VRAM を持つ場合、AI 推論には VRAM の容量が制約になります。たとえば VRAM 6GB の GPU では、それ以上のモデルはロードできません。RAM が余っていても使えないのです。

Mac の UMA では、8GB という数字がそのまま CPU・GPU・Neural Engine 全員が使える共有プール の総量です。Windows の「RAM 16GB + VRAM 6GB」という分断された構成より、「8GB を誰でも使える」構成のほうが、AI 用途では実質的に広く使えることすらあります。

理由2:メモリ圧縮が極めて機能する

macOS は メモリ圧縮(Memory Compression) を非常に積極的に活用します。使用頻度が低いメモリ上のデータをリアルタイムで圧縮し、物理メモリの実効容量を大幅に引き延ばします。

Apple Silicon の CPU は、このメモリ圧縮・展開処理が高速かつ低電力で動作するよう最適化されています。8GB の物理メモリが、体感的には 10〜12GB 相当として振る舞うことも珍しくありません。

理由3:SSD スワップが「使い物になる」速度で動く

メモリが不足すると、OS はストレージ(SSD)をメモリの代わりに使う「スワップ」を行います。一般的な PC では SSD スワップは体感的にとんでもなく重くなりがちですが、Mac の SSD はコントローラーまで Apple 設計で、読み書き速度が 5〜7GB/s 以上に達します。

この速度は多くの一般的な PC の SSD(500MB/s〜3GB/s)と比較になりません。スワップが発生しても処理の遅延が起きにくく、メモリをわずかに超えたワークロードでも滑らかに動き続けます。

8GB の現実的な限界も知っておく

ただし、8GB は万能ではありません。Ollama で 7B クラスのモデルを常駐させると、空きメモリはほとんどなくなります。そこに他のアプリを開いたり、ブラウザタブを多数開いたりすると、スワップが増加し推論速度が落ちます。

- API エージェント専用機として使う(ローカルモデルなし):8GB で快適に動作

- 7B モデルをローカルで常駐させる:8GB でも動きますが、他作業との並行は厳しい

- 13B 以上のモデルをローカルで扱いたい:16GB 以上を強く推奨

「AI の家」として Mac Mini を選ぶなら、ローカルモデルも扱いたい場合は 16GB が実質的なスタートラインです。8GB モデルは「クラウド API に繋ぐエージェント専用機」として割り切れば、コストパフォーマンスは依然として最高水準を誇ります。

私は上述のM1 Mac Mini上でClaude Codeを中心にMCPで様々なWebサービスと連携して自立的に動作する司令塔として24時間、常時稼働させています。

ワットパフォーマンスという本質的な指標

AI を24時間365日稼働させるなら、消費電力は「毎月の固定費」です。

各世代の Mac Mini の消費電力と、AI 常駐ホストとして使った場合の実効コストを比較してみましょう。

| モデル | アイドル時 | 負荷時(目安) | 平均(常駐AI想定) | 年間電気代(30円/kWh) |

|---|---|---|---|---|

| Mac Mini M1 | 約6〜8W | 約20〜39W | 約12W | 約3,200円 |

| Mac Mini M2 | 約6〜8W | 約22〜35W | 約13W | 約3,400円 |

| Mac Mini M2 Pro | 約7〜10W | 約30〜60W | 約18W | 約4,700円 |

| Mac Mini M4 | 約7〜10W | 約25〜35W | 約15W | 約3,900円 |

| Mac Mini M4 Pro | 約8〜12W | 約35〜65W | 約20W | 約5,300円 |

| Intel NUC(i7クラス) | 約15〜20W | 約60〜80W | 約45W | 約1.2万円 |

| Windows デスクトップ(GPU搭載) | 約80〜120W | 約200〜350W | 約150W | 約4万円 |

Claude Code エージェントや API ベースの軽量エージェントを動かす「常駐 AI」用途なら、多くの時間はアイドルに近い状態で動き、ときどきタスクをこなすというパターンになります。

つまり Mac Mini M1 の場合、年間3,000円台、最上位の M4 Pro でも5,000円台という、他のあらゆる常時稼働構成を大きく下回る電気代で AI を常時稼働させることができるわけです。

世代ごとの「AI 用途としての使い分け」

M1(最高16GB)——「API エージェント専用機」として今でも現役

2020年登場の M1 Mac Mini は、中古市場で3〜5万円台から入手できます。ローカルモデルの大型化には追いつかないものの、Claude Code・OpenAI Agents SDK・n8n などの API エージェントを常駐させるだけなら、性能的に全く問題はありません。

- Ollama + Llama 3 8B:動作します。推論速度は遅いですが実用圏内です。

- API エージェント(Claude / GPT-4o):快適に動作しています。Mac 側の負荷は最小。

- 年間電気代:約3,200円

「とにかく安くAIの家を作りたい」なら、中古 M1 Mac Mini というのもアリなんじゃないかと思います。

M2(8〜24GB)——バランス型のスタンダード

事務所ではM2 Mac Miniが常時稼働しています。

M2 は M1 比でメモリ帯域が約50%向上し、GPU コアも増加しています。8GB モデルでも小型モデルの推論は快適で、16GB あれば 13B クラスを常駐させながら他の作業も並行できます。M2 Pro(32GB)なら 30B クラスへの挑戦も視野に入ります。

- Ollama + Mistral 7B(16GB):快適な推論速度です。

- Ollama + Llama 3 13B(16GB):動作しますが余裕は少なめになります。

- API エージェント:快適です。

- 年間電気代:約3,400〜4,700円

M2 は現時点で「コスパと性能のバランス」が最も取れた世代です。

新品より中古・整備済品での入手が現実的で、AI ホストとしての採用事例も多くなっています。

M3(なし)——Mac Mini には M3 は存在しない

注:Mac Mini の M3 世代は製品化されませんでした。M2 の次は M4 への直接更新となっています。MacBook Air/Pro や Mac Studio には M3 が存在しますが、Mac Mini のラインアップでは飛ばされています。

M4(16〜64GB)——現行最高峰。ローカル AI の本命

2024年11月発売の M4 Mac Mini は、Neural Engine が前世代比で大幅強化され、メモリ帯域幅も向上しました。

(私は買えずにいます。M2でも十分使えているからです)

M4 Pro(24〜64GB)に至っては、個人用ハードウェアとしてはローカル AI 推論の到達点に近いと言えるでしょう。

(こうやって書いていると、欲しくなります)

- Ollama + Llama 3 8B(16GB):非常に高速なんでしょうね。

- Ollama + Mistral 22B / Llama 3 70B(64GB):M4 Pro で現実的な速度と言われています。

- API エージェント:当然快適。完全にオーバースペックの余裕ありなので、この用途で使うのはもったいないです。

- 年間電気代:約3,900〜5,300円

静音性という「共存」の条件

AI アシスタントを「住まわせる」には、物理的に同じ空間に置けなければ意味がありません。

書斎、寝室の棚、リビングの一角。どこに置いても、Mac Mini はほぼ無音に近いです。M1 から M4 まで、アイドル時はファンが止まることも多く、軽いエージェントタスク程度では聞こえません。フル推論を走らせ続けてようやく、かすかなファン音が聞こえる程度です。

これは、ラックマウントのサーバーや GPU を積んだワークステーションでは到底実現できない共存性です。データセンターに置けばネットワーク遅延と月額費用が生じ、クラウド VM に置けば常時コストが積み上がります。Mac Mini はその両者を、自室のデスクの上で置き換えます。

「常駐AI」の実践的な構成例

構成A:API エージェント型(Claude Code / OpenAI Agents SDK)

- 常駐プロセスとしてエージェントを起動

- メール・カレンダー・Slack などを MCP サーバー経由で接続

- スケジュールトリガーで朝のブリーフィング、夜のサマリーを自動生成

- モデルはクラウド API(Claude / GPT-4o)に投げるため、Mac 側の負荷は軽微

- 推奨世代:M1 以降すべて対応。自宅のM1 でも十分稼働できています。

構成B:ローカルモデル型(Ollama + llama.cpp)

- Mistral 7B / Llama 3 8B などを UMA メモリ上に常駐

- 機密データを安全にローカル処理。

- 外部 API ゼロのため、月額コストは電気代のみ

- 推奨世代:M2 16GBで問題なく動いています。M4だったらさらに快適となるでしょう。

構成C:ハイブリッド型

- 日常の軽いタスクはローカルモデルで処理

- 高精度が求められるタスクのみクラウド API へエスカレーション

- コストと品質のバランスを自動制御

- 推奨世代:M2 Pro / M4 以上じゃないときついですね。

医療機関向けに稼働テスト中

以上のことから、機密データを扱う医療機関のローカルAIサーバーとして、上記構成B:ローカルモデル型のシステムを構築しテスト中です。

より大きなモデルを扱えるようにM4 64GBの構成となる予定です。

カルテや紹介状などの作成支援。音声入力。医療スタッフのシフト作成などから始まって、医師の学会での発表資料作成支援、将来的には画像分析に至るまでスケーラブルに発展させていく予定です。

「どの世代を選ぶか」の判断軸

| 目的・状況 | 推奨モデル |

|---|---|

| とにかく安くはじめたい | 中古 M1(3〜5万円台) |

| コスパ重視・7B〜13B モデルを動かしたい | M2 16GB(新品・整備済品) |

| 30B クラスも視野に入れたい | M2 Pro 32GB |

| 新規購入・長く使いたい | M4 16GB または M4 Pro |

| ローカル大型モデルを本格運用したい | M4 Pro 48〜64GB |

Mac Mini が「世界最良のAIの家」である理由

世代を超えて共通する事実があります。

データセンターに近い稼働率で動かしながら、電気代はラテマネーレベル。GPU 搭載 PC に匹敵する AI 推論性能を、無音で自室に置けます。UMA によってメモリ帯域はローカル AI 推論に最適化されており、同価格帯の x86 マシンとは別次元のワットパフォーマンスを発揮します。

M1 は2020年の設計でありながら、2026年現在もなお「API エージェントの家」として私の自宅では現役で通用しています。これは、UMA という設計が AI ワークロードと本質的に相性が良いためです。

電気代が高く、静粛性が求められ、省スペースが重視される日本の住環境においては、その優位性はさらに際立ちます。

Mac Mini はもはや「サブ PC」ではありません。M1 であれ M4 であれ、24時間自分の代わりに働く AI アシスタントの、最も電力効率に優れた”家”の一つです。

まとめ

- UMA は M1 から M4 まで全世代共通。CPU・GPU・Neural Engine が同一メモリを共有し、AI 推論効率が根本的に異なります

- 消費電力12〜20W前後(平均)で、年間電気代は約3,200〜5,300円台。x86 構成の数分の一です

- ほぼ無音・省スペースで自室に常設でき、クラウドやデータセンターに依存しません

- M1 は「安価な API エージェント専用機」、M4 は「ローカル AI の本命」として、それぞれ明確な役割を持ちます

- 「AI を使う道具」から「AI が住む家」へ——Mac Mini M1〜M4 は、その要件を世界最高水準で満たすプラットフォームです

コメント

コメント一覧 (1件)

突然のご連絡失礼いたします。NewCurrentの伊藤と申します。

日頃より貴サイトを拝見しており、特にユーザーの悩みに寄り添う深い考察や、丁寧な情報発信の姿勢に、同業者として大変刺激を受けております。

実は私も現在、メディア(https://asset-inc.jp/newcurrent/)を運営しております。

コンテンツの親和性が高く、相互にリンクを設置することで、双方の読者様にとってより網羅性の高い情報提供が可能になると考えております。

貴サイトの資産となるような良質な記事作りを心がけておりますので、ぜひ相互リンクをご検討いただけないでしょうか。

お忙しいところ恐れ入りますが、もしご興味をお持ちいただけましたら、貴社のリンク掲載をさせていただきますので、

簡単なご返信をいただけますと幸いです。何卒よろしくお願い申し上げます。

連絡先:backlink@tokyo-web-development.com

よくある質問:https://x.gd/BWIgF

もしお返事いただける際は当社管理番号を削除せずご返信願います。

管理番号: ae94f9d2-387f-40e5-af4d-387be81e1be2